La tecnología Facial Liveness Verification (FLV) es una de las implementaciones de seguridad más modernas, empleada actualmente para la autenticación de identidad en dominios web que requieren las más altas verificaciones de usuarios. A pesar de que múltiples proveedores de servicios en la nube ya ofrecen esta solución y está en un proceso de adopción generalizada, aún se desconoce hasta dónde pueden llegar los riesgos de seguridad en esta tecnología.

Una investigación a cargo de expertos de Pennsylvania State University, Zhejiang University y Shandong University indaga en las características intrínsecas de FLV, su funcionamiento en escenarios reales y, más importante aún, los riesgos de seguridad a los que esta tecnología podría verse expuesta y en qué medida.

El trabajo de estos especialistas derivó en el desarrollo de LiveBugger, un marco de ataque impulsado por tecnología deepfake que permitiría a los actores de amenazas evadir las protecciones FLV en tiempo real y de forma automatizada. Este marco de trabajo permitió a los investigadores analizar de forma empírica un conjunto de plataformas FLV, realizando algunos hallazgos interesantes.

A continuación se profundizará en el uso de FLV y en el por qué es importante que esta tecnología sea adecuadamente protegida contra el uso malicioso del deepfake y otras técnicas similares.

La nueva forma de autenticación

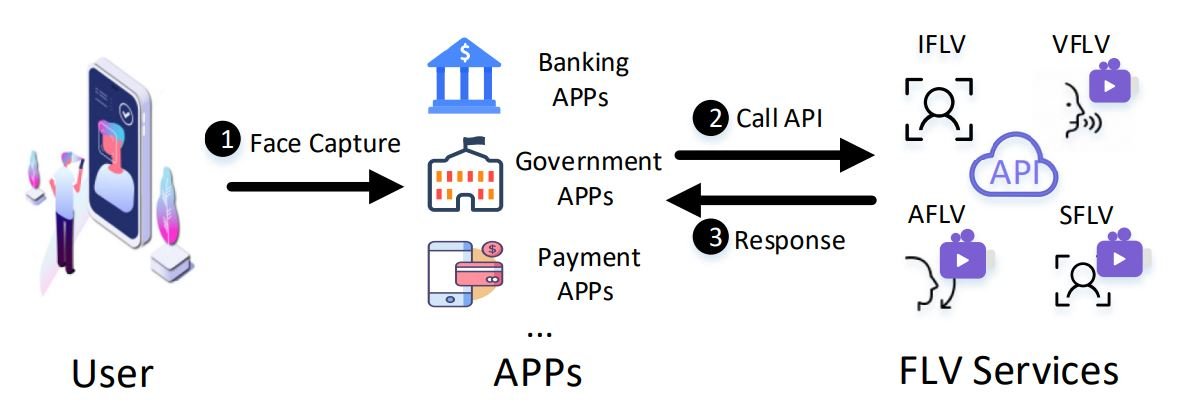

Esta tecnología fue implementada como una alternativa a las contraseñas heredadas y consiste en validar la identidad de un usuario en línea a partir de una imagen o video de su rostro. Cada vez más plataformas en línea usan FLV gracias a sus bajos requerimientos de hardware y su aparente confiabilidad. Los bancos, plataformas de redes sociales o servicios gubernamentales usando FLV requieren que el usuario capture su rostro en una imagen o video que deberá ser enviado a una API de FLV para su verificación, evitando así que potenciales actores de amenazas ingresen a estas plataformas con nombres de usuario y contraseñas robadas.

Además de que su implementación no es un proceso altamente complejo y demandante, su adopción masiva será más fácil gracias a que las plataformas en la nube han comenzado a proporcionar tecnología FLV como una Plataforma como Servicio (PaaS), reduciendo los costos y acelerando su funcionamiento. Es por ello que los especialistas estiman que este mercado alcanzará un valor de más de $16 mil millones USD para finales de 2024.

El crecimiento acelerado en la implementación de FLV por un momento dejó de lado los análisis de seguridad relacionados con esta tecnología, algo poco recomendable considerando que las potenciales fallas de seguridad en FLV podrían ser heredadas por versiones posteriores, lo que afectaría a millones de usuarios, especialmente aquellos que deben autenticarse en servicios FLV PaaS.

Los primeros análisis sobre tecnología FLV se enfocaban en el potencial uso de imágenes del usuario afectado para ingresar arbitrariamente a los sistemas de reconocimiento facial, por lo que estos fueron los primeros riesgos de seguridad abordados por los desarrolladores de soluciones FLV. Si bien era necesario implementar estas medidas de seguridad, los especialistas consideraban que esto no respondía a una duda fundamental: ¿Qué tan eficientes son los sistemas FLV frente al deepfake?

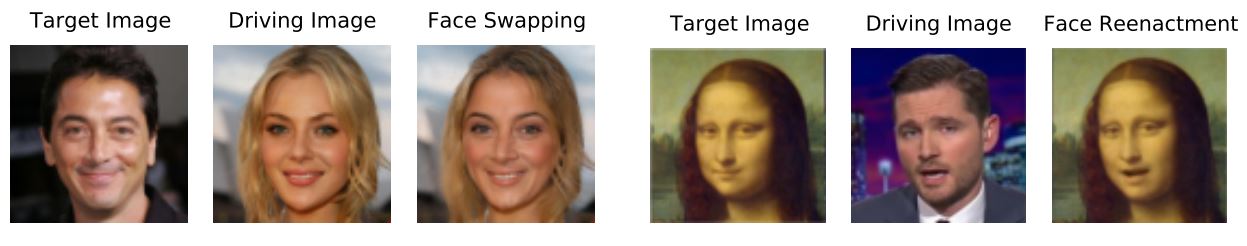

Los especialistas creen que el uso de tecnología deepfake permitiría ataques más sofisticados contra implementaciones FLV, ya que esa técnica es capaz de generar un movimiento realista en una imagen creada a partir de fuentes de acceso públicas, ya sean perfiles de redes sociales, cuentas email, etcétera, algo que los ataques FLV convencionales no podrían concretar.

Además de la sola existencia de la tecnología deepfake, la poca experiencia que demanda su uso es otro factor clave de riesgo a considerar, ya que entre menos complejo sea un ciberataque, más riesgo habrá de encontrar este ataque replicado en escenarios reales.

Evaluando la seguridad de la autenticación FLV

LiveBugger, el marco de trabajo desarrollado por este equipo de investigación, integra diversas técnicas del más avanzado deepfake para la evaluación de un riesgo de seguridad FLV que hasta entonces no había sido explorado en escenarios reales.

A grandes rasgos, LiveBugger depende de tres elementos clave:

- Motor de Inteligencia: Proporciona un conjunto completo de funciones de autenticación compatibles con los principales proveedores de FLV PaaS. Este motor valida automáticamente las características de defensa FLV utilizando un conjunto de datos de sondeo completamente

- Motor Deepfake: La primera versión del marco de trabajo integra seis técnicas deepfake avanzadas con las que LiveBugger podrá sintetizar todos los videos falsos necesarios para evadir la autenticación FLV exitosamente

- Motor de Análisis: Incluye un conjunto de métricas personalizables con gran cantidad de información disponible para respaldar la evaluación detallada de FLV

Resultados de la evaluación

LiveBugger evalúa detalladamente las API FLV más representativas, incluyendo aquellas basadas en imagen, voz y movimiento. Gracias a este análisis, los investigadores descubrieron características muy interesantes, incluyendo:

- La mayoría de las implementaciones FLV PaaS no cuentan con mecanismos de detección deepfake en sus API

- Aquellos proveedores que usan mecanismos anti deepfake arrojaron resultados preocupantemente bajos durante el análisis

- El rendimiento de los sistemas FLV con procesos aleatorios (usando códigos de voz aleatorios o secuencias de acción) es apenas aceptable en relación con la autenticación FLV predeterminada

A pesar de que las soluciones FLV sigan avanzando como se espera, también lo hará la tecnología deepfake, por lo que los investigadores creen que este es un buen momento para que los prestadores de estos servicios implementen todas las medidas de seguridad necesarias para evitar el abuso de este mecanismo de autenticación.

Para conocer más sobre riesgos de seguridad informática, malware, vulnerabilidades y tecnologías de la información, no dude en ingresar al sitio web del Instituto Internacional de Seguridad Cibernética (IICS).

El cargo ¿Cómo usar deepfake para engañar a los sistemas biométricos de autenticación FLV? apareció primero en Noticias de seguridad informática, ciberseguridad y hacking.

Ver Fuente

No hay comentarios.:

Publicar un comentario